Преди година, когато направих публично социален експеримент, за да сравня разработка на софтуер с помощта на изкуствен интелект (AI) с тази на традиционното програмиране, се сблъсках със скептицизъм и откровен хейт, че хвърлям камък в бранша. Контрааргументите се обединиха до тезата, че развитието на изкуствения интелект не обръща с главата надолу IT индустрията, образованието, пазара на труда и живота ни като цяло. Или поне не с тези темпове. Факт е обаче, че AI отдавна премина фазата на безобиден логистичен помощник, генератор на текст, трансформатор на професии или инструмент за киберсигурност.

Намираме се в повратна точка в човешката история и използването на AI от САЩ и Израел в Иран трансформира из основи самата природа на войната, както и деликатния баланс между държавата и корпоративния сектор.

AI и националната сигурност

Интеграцията на генеративни AI модели и автономни системи в националната сигурност на САЩ бе формализирана през 2025, но тази безпрецедентна технологична революция не се случи във вакуум. Тя бе катализирана от масивно финансиране чрез закона OBBBA (One Big Beautiful Bill Act), подписан официално на 4 юли м.г. Освен радикалните промени във вътрешната политика, законът инжектира целеви 150 милиарда долара в новото поколение отбрана - от автономни системи до космически щитове. Днес тези пари вече дават своите резултати на бойното поле.

Зад завесата на секретността, класифицираните брифинги и ПР съобщенията на Силициевата долина, реалността е далеч по-сложна.

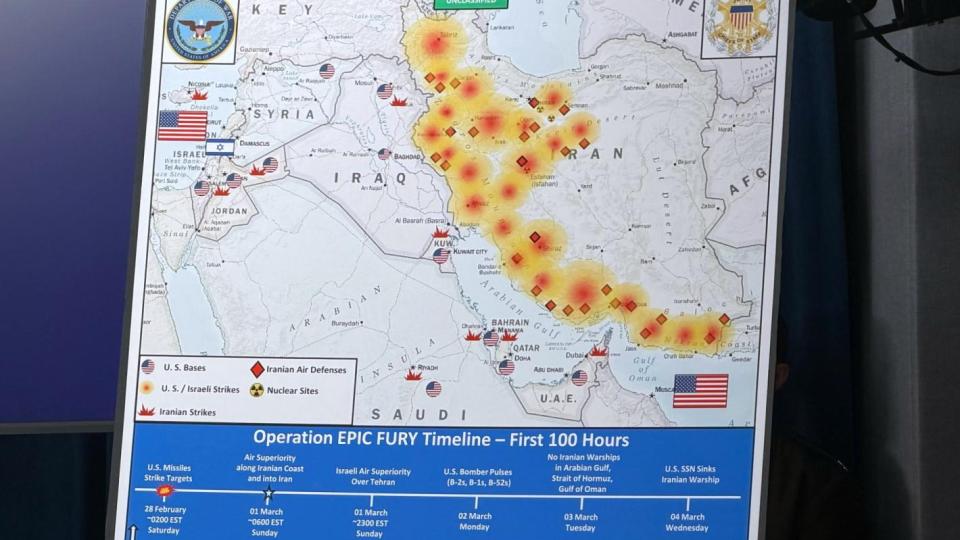

Илюзията за човешкия контрол и цената на Операция "Епична ярост"

Доскоро западната военна доктрина категорично твърдеше, че човекът винаги ще има последната дума при използването на смъртоносна сила - концепция, известна като "human-in-the-loop" (човек във веригата, бел. а). В реални бойни условия обаче, пред лицето на огромни масиви от данни, тази етична концепция бързо се разпада и се превръща в "human-on-the-loop" (човек просто наблюдаващ веригата).

Най-яркото доказателство за това дойде по време на мащабната военна кампания срещу Иран, кодирана като Операция "Епична ярост" (Operation Epic Fury), която започна в края на февруари 2026 г. Само през първите 24 часа на операцията американските сили нанесоха удари по над 1000 цели, използвайки B-2 стелт бомбардировачи и масиран ракетен обстрел. За да поддържа това безпрецедентно темпо, US армията използва AI системата Project Maven за обработка на огромния поток от сателитни снимки, прихванати комуникации и данни от дронове.

Как става това на практика? Системата генерира около 1000 потенциални цели дневно. Изкуственият интелект синтезира разузнавателни доклади и локализира обекти със скорост, абсолютно невъзможна за човешки анализатори, съкращавайки времето от идентифициране на целта до нанасяне на удар (т.нар. kill chain) до под 4 часа. Тази алгоритмична скорост обаче има своята смразяваща цена. AI системите не притежават човешко разбиране за контекст. Те виждат света като пиксели и вероятностни разпределения.

При един от най-тежките инциденти в кампанията, при който крилата ракета Tomahawk удари и срина до основи начално училище в Иран, загинаха общо 168 души, включително 110 деца. Това повдигна много въпроси дали системата не е класифицирала сградата като склад за логистика на Ислямския революционен гвардейски корпус. Докато военните побързаха да обвинят остарели топографски данни, водещи AI учени предупредиха за нещо много по-страшно - за присъщата на AI моделите "халюцинация" - феномен, при който алгоритъмът генерира напълно фалшив, но изглеждащ логично резултат. В контекста на чатбот това води до грешен отговор, в контекста на война резултатът е невинни жертви. При подобна скорост на вземане на решения се проявява и т.нар. automation bias (склонност към доверяване на машината), а ролята на човека-оператор се свежда до рутинно натискане на бутона "Одобрявам", тъй като физически няма време за проверка на данните на алгоритъма.

Войната за етиката

Технологичните компании вече не могат просто да диктуват правилата на армията от удобните си кампуси в Калифорния. В началото на 2026 г. избухна исторически скандал, който преначерта границите на корпоративната независимост. Министерството на войната постави директен ултиматум на AI гиганта Anthropic (създател на езиковия модел Claude) да премахне своите етични "червени линии", заложени в техния така наречен "Конституционен AI". Компанията категорично отхвърли идеята нейният модел да бъде използван за обработка на данни за масово вътрешно наблюдение на граждани или за програмиране на напълно автономни смъртоносни оръжия.

След като изпълнителният директор на Anthropic Дарио Амодеи отказа да отстъпи пред натиска, правителството прие драстични мерки. На 4 март 2026 г. администрацията официално обяви компанията за "риск за веригата на доставки" (supply chain risk) - изключително тежък етикет, традиционно запазен за компании от чуждестранни противници. Това ефективно блокира Anthropic от всякакви държавни и военни договори, нанасяйки тежък удар по бизнеса им. В отговор, на 9 март Anthropic заведе две безпрецедентни съдебни дела срещу администрацията на САЩ, обвинявайки я в незаконно отмъщение, злоупотреба с власт и нарушаване на Първата поправка.

Вакуумът обаче бе запълнен на мига. На мястото на Anthropic веднага стъпи OpenAI. Те вече бяха подготвили почвата с масивен договор за "водене на бойни действия" (warfighting) за 200 милиона долара, подписан още през лятото на 2025 г. Новият им, още по-дълбок ангажимент с Пентагона, за класифицирани AI системи, предизвика остра вълна от недоволство сред собствените им служители. Много от тях напуснаха. Стигна се и до масова кампания в социалните мрежи за бойкот и изтриване на приложението ChatGPT от милиони потребители по света. Етиката официално загуби битката срещу военните бюджети.

Силициевата долина облича униформа: Противоречивият "Отряд 201"

Границата между корпоративния софтуерен сектор и висшето военно командване вече не е просто размита - тя е официално заличена. На 13 юни 2025 г., на специална церемония в историческата зала Conmy Hall във Вирджиния, армията на САЩ създаде Detachment 201 (Отряд 201) или т.нар. Executive Innovation Corps.

В ход, който шокира мнозина традиционалисти във въоръжените сили, четирима висши ръководители от най-мощните технологични корпорации в света получиха директно офицерски звания "подполковник" (Lieutenant Colonel) в армейския резерв, без да преминават през години традиционно военно обучение, физически изпити или боен опит.

Това са:

- Кевин Уейл - Главен продуктов директор на OpenAI

- Шям Санкар - Главен технологичен директор на Palantir

- Андрю Босуърт ("Боз") - Главен технологичен директор на Meta

- Боб Макгрю - Съветник в Thinking Machines Lab (бивш кадър на OpenAI)

Тази инициатива, част от мащабната Армейска трансформационна инициатива, цели да внесе бързината на Силициевата долина в тромавия Пентагон. Но тези назначения предизвикаха ожесточени критики за крещящ и структурен конфликт на интереси. Същите тези ръководители вече имат достъп до най-високите нива на класифицирана информация и съветват армията за това какви технологични трансформации са необходими. В същото време, компаниите, които те представляват (като Palantir и OpenAI), печелят държавни договори за стотици милиони долари. Критици питат: как може подполковник да даде обективен съвет на армията, ако решението води до милиарди печалба за компанията, ръководена от същия цивилен гражданин?

Проектът "Златен купол: Космическият AI щит

Цялата тази нова AI инфраструктура, талант и изчислителна мощ са критични за най-мащабния, амбициозен и скъп отбранителен проект на САЩ в момента - инициативата "Златен купол" (Golden Dome). Обявен първоначално в началото на 2025 г. като надграждане на идеята за "Железен купол", това не е просто локална защита, а напълно интегриран противоракетен щит над цялата континентална територия на САЩ.

Оценяван първоначално на 175-185 милиарда долара (макар Бюджетната служба на Конгреса да предупреждава, че реалната цена може да надхвърли 500 милиарда долара в следващите десетилетия, бел. а.), проектът има за цел да бъде напълно оперативен до 2029 година. Той вече получи масивно първоначално финансиране от близо 25 милиарда долара.

"Златният купол" е немислим без съвременния изкуствен интелект. Системата предвижда разполагането на хиляди сателити в ниска околоземна орбита (LEO), оборудвани със сензори и дори кинетични прехващачи. AI мрежата ще действа като автономен "мозък", интегрирайки данни от космически радари, наземни системи и сензори по целия свят. Нейната задача е да изчислява хаотичните и непредсказуеми траектории на хиперзвукови ракети, които се движат с над 5 пъти скоростта на звука и маневрират непредсказуемо, в реално време.

Тъй като човешкото време за реакция е твърде бавно, за да прихване хиперзвуково оръжие, AI системата на "Златния купол" ще има правомощията сама да взема решения за изстрелване на кинетични и лазерни оръжия в Космоса и атмосферата. Това прехвърля контрола над защитата на нацията изцяло в ръцете на автономни алгоритми.

Новият алгоритмичен световен ред

Ерата на мирния изкуствен интелект, в която се тревожихме за това дали ChatGPT ще напише домашното на някой ученик или ще замени копирайтърите, приключи безвъзвратно.

Внедряването на AI за военни цели създава съвършено нов алгоритмичен военно-промишлен комплекс, в който технологични гиганти и държава са слети в едно. Докато обществените дебати за това дали изкуственият интелект ще отнеме работни места в офисите продължават, реалните системи вече обработват смъртоносни мишени на бойното поле, управляват мултимилиардни бюджети в Космоса и предефинират глобалната геополитика. Войната на бъдещето вече не се води само с куршуми и барут, а с петабайти данни, изчислителна мощ и алгоритми, които вземат решения за живот и смърт по-бързо, отколкото човек може да мигне.

И най-големият въпрос остава: Когато машините започнат да водят войни, кой ще носи отговорност за грешките им?

Източник: dir.bg